Depuis que les modèles conversationnels et les outils de création de contenu se sont imposés dans les rédactions et les studios, la même question revient, des conférences professionnelles aux comités éditoriaux : que reste-t-il quand l’automatisation permet de produire à grande vitesse textes, visuels et formats courts ? En France, l’accélération est visible à la fois dans les expérimentations internes et dans la multiplication d’accords entre plateformes d’intelligence artificielle et éditeurs, sur fond de lutte pour la monétisation et la visibilité. Dans ce paysage, une tendance gagne du terrain : le retour en grâce des contenus incarnés, portés par des signatures, des visages, une narration assumée, et des méthodes de reportage traçables. L’enjeu dépasse la simple préférence éditoriale. Il touche à l’authenticité perçue par le public, à l’expérience utilisateur sur des interfaces pilotées par recommandations, et à la capacité des médias à conserver une “prime de confiance” au moment où la synthèse algorithmique devient un réflexe de consultation de l’actualité.

Accords avec les plateformes d’IA et industrialisation de la production éditoriale

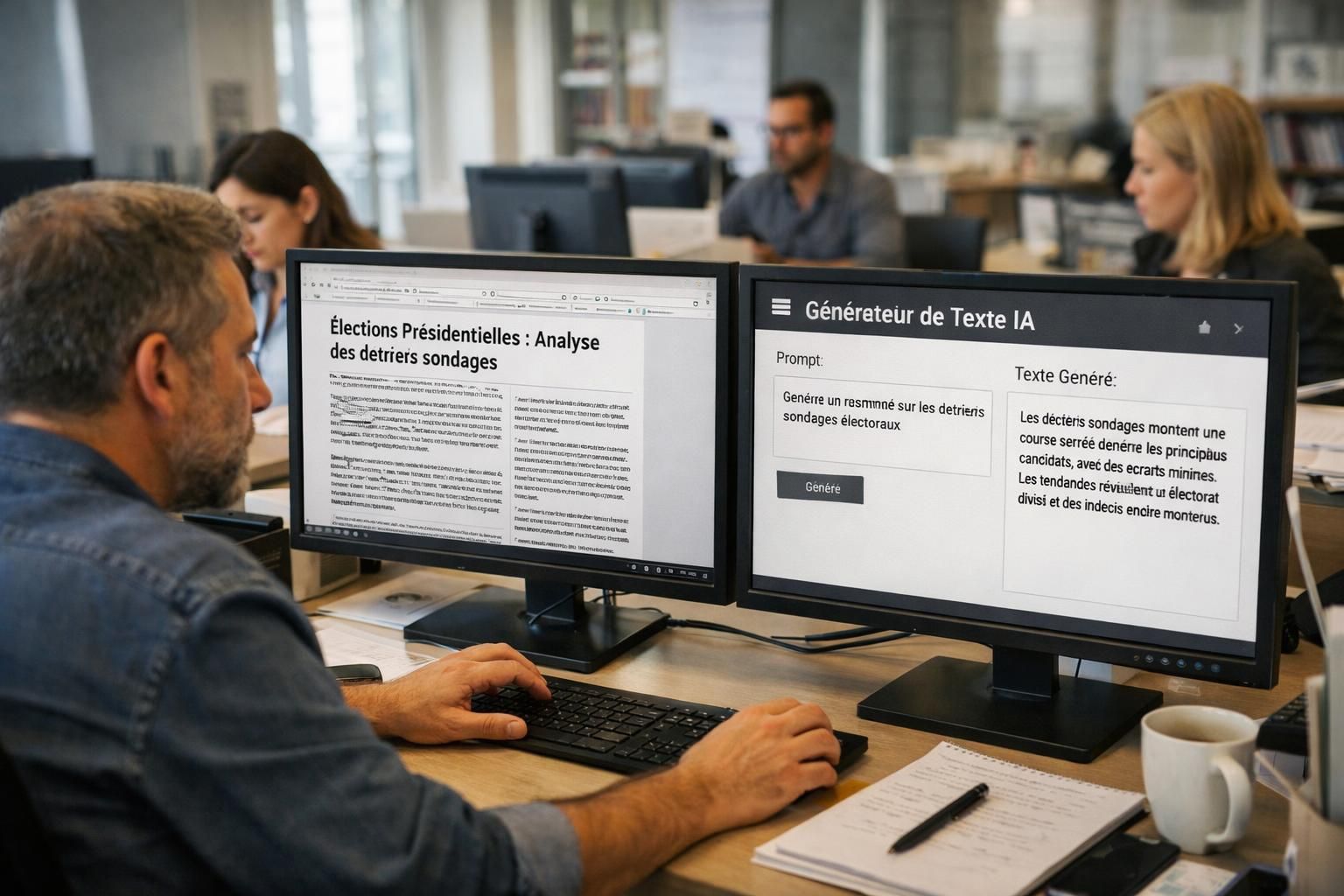

La vague actuelle s’inscrit dans une logique d’industrialisation : standardisation des formats, rationalisation des chaînes de production et diffusion optimisée par les algorithmes. Les médias cherchent à éviter que leurs articles ne soient aspirés, résumés et redistribués sans contrôle, tandis que les acteurs de l’IA tentent d’obtenir un accès légal à des contenus fiables pour améliorer leurs réponses.

Dans ce contexte, plusieurs initiatives récentes ont fait date. Le Monde a été le premier média français à annoncer un accord avec OpenAI, revendiquant une stratégie consistant à peser dans la structuration de ces nouveaux usages plutôt que de rester à l’écart. Côté modèles économiques, Perplexity a mis en avant un dispositif de partage de revenus, avec une enveloppe initiale annoncée de 42,5 millions de dollars, signe que la valeur des archives et du travail éditorial est désormais discutée contractuellement.

La dynamique est aussi alimentée par des financements fléchés vers le journalisme. OpenAI et Microsoft ont communiqué sur des programmes de soutien dépassant chacun 10 millions de dollars pour des initiatives liées à l’information et à l’innovation dans les médias. Dans les rédactions, cette circulation d’argent et de technologies crée un double mouvement : l’outillage se généralise, mais la dépendance potentielle aux interfaces d’IA reconfigure la distribution. Une fois le résumé obtenu en conversation, combien d’utilisateurs cliquent encore vers la source ? La question structure déjà les négociations.

Le paradoxe de la visibilité : de la synthèse instantanée au retour vers la source

Les plateformes d’IA promettent une navigation plus fluide et une meilleure expérience utilisateur : réponses directes, contextualisation rapide, comparaison de sources. Mais la synthèse peut aussi aplatir la complexité, et déplacer l’attention de l’article vers l’interface. C’est là qu’un effet contre-intuitif a été mis en avant par Le Monde, qui a évoqué une conversion nettement supérieure à celle observée via des plateformes traditionnelles, avec un ordre de grandeur avancé de 20 à 50 fois dans certains cas. Les modalités exactes varient selon les dispositifs, mais l’idée est devenue centrale : dans un univers saturé de textes “interchangeables”, la crédibilité identifiée peut redevenir un moteur de retour vers la source.

Ce basculement ouvre un espace pour l’humanisation des formats : un lecteur qui doute d’un résumé voudra vérifier, comparer, comprendre “qui parle” et “d’où viennent les faits”. À condition que les médias rendent cette traçabilité simple et lisible, l’IA, paradoxalement, peut renforcer l’intérêt pour les productions les plus signées.

Les contenus incarnés comme réponse à l’automatisation et à la crise de confiance

Face à l’automatisation, les contenus incarnés ne se résument pas à mettre un visage à l’écran. Ils reposent sur une chaîne de responsabilité : enquête, méthode, choix éditoriaux et transparence sur ce qui est confirmé, recoupé, ou simplement rapporté. Dans un flux où la viralité peut primer sur l’exactitude, cette incarnation devient un repère cognitif.

Le phénomène n’est pas détaché des réseaux sociaux, qui continuent de brouiller la frontière entre information et divertissement. La rapidité de circulation sur des plateformes comme Instagram ou Facebook rend la correction plus difficile, et la tentation du format “prêt à consommer” plus forte. Or les IA génératives ajoutent une couche : elles réécrivent et recomposent, parfois avec des erreurs, ce qui renforce l’utilité de formats où l’on peut identifier une démarche et un auteur.

Du reportage à la narration : l’authenticité comme avantage concurrentiel

Dans les rédactions, l’incarnation passe aussi par des arbitrages concrets : donner du temps à des journalistes pour documenter, contextualiser, et produire des récits où la complexité n’est pas sacrifiée. C’est une réponse directe au risque de “simplification algorithmique” souvent souligné dans les travaux sur l’impact des LLM sur l’information : la lisibilité progresse, mais la nuance se perd.

La recherche de authenticité se joue également dans les formats immersifs. La réalité augmentée et la réalité virtuelle, déjà testées dans des productions de reportage et d’investigation, cherchent moins l’effet spectaculaire que la restitution d’un terrain, d’une ambiance, d’une chronologie. Là encore, l’industrialisation a ses limites : on peut générer des images, mais pas une présence sur place. Cette distinction devient un marqueur de valeur au moment où les contenus générés se multiplient.

Régulation, littératie numérique et stratégies de souveraineté dans la transformation digitale

La réponse ne peut pas être uniquement éditoriale. Elle est aussi éducative et réglementaire, car l’IA modifie la manière d’apprendre l’information. En France, l’éducation aux médias et la littératie numérique prennent une place croissante dans les programmes scolaires et universitaires, avec un objectif : savoir identifier des sources, comprendre les mécanismes de recommandation, et reconnaître les signaux d’une information douteuse.

Sur le plan institutionnel, le paysage a changé : le CSA a laissé place à l’Arcom, qui a repris et élargi les missions de régulation de l’audiovisuel et du numérique. À l’échelle européenne, le Digital Services Act et le Digital Markets Act constituent une base, même si l’adaptation aux usages spécifiques de l’IA générative reste un chantier suivi de près par les acteurs du secteur.

Entre innovation numérique et contrôle éditorial : l’exemple des outils propriétaires et des partenariats

Certains médias misent sur des outils internes pour garder la main sur leurs corpus et leurs critères de qualité. Arte a ainsi développé un chatbot conversationnel, illustrant une stratégie où l’innovation numérique sert d’abord la cohérence éditoriale et la médiation avec le public. Du côté des alliances, France Télévisions a exploré des partenariats avec Mistral AI, dans une logique souvent présentée comme un enjeu de souveraineté : limiter la dépendance à des infrastructures et modèles extra-européens, tout en accélérant l’expérimentation.

Reste un point de tension durable : la désinformation à grande échelle. Europol a documenté la montée des deepfakes et l’usage criminel de ces techniques, tandis que des instances comme l’Académie des Technologies ont mis en avant l’amplification des “pathologies de l’information” par les systèmes génératifs. Dans ce contexte, la promesse des contenus incarnés est simple mais exigeante : rendre visible le travail, pas seulement le résultat. Et c’est souvent cette preuve de méthode, plus que le volume produit, qui fait la différence dans la transformation digitale des médias.